Le chaos originel

Le désordre à l’échelle atomique et l’entropie statistique

A côté du « principe d’ordre » créé par les interactions entre atomes, on trouve dans la nature un « principe de désordre » dont les effets sont rassemblés dans la notion d’entropie.

Le chaos originel

Le principe de désordre vient du caractère aléatoire (on dit aussi « chaotique ») des déplacements des atomes lorsqu’ils sont libres de se mouvoir. Dans un liquide, ces déplacements chaotiques sont appelés « mouvement brownien ». Ces déplacements d’atomes, dès lors qu’un degré de liberté existe, sont universels : ce sont eux qui sous-tendent les phénomènes de diffusion et de mélange. Les concepts de température, chaleur et entropie y sont intimement reliés. En particulier, la température caractérise la vitesse et l’amplitude de ces déplacements.

Le mouvement chaotique est un problème statistique analysé par Einstein et Jean Perrin au début du XXè siècle. Imaginons des atomes libres de se déplacer dans l’espace par pas de distance L. On montre que, après 10000 pas, les atomes se sont déplacés en moyenne de la distance (racine)10000×L = 100×L . Cela provient du caractère équiprobable de toutes les directions possibles de déplacement des atomes.

La diffusion est typiquement un phénomène qui varie en racine carrée du nombre de pas, c’est-à-dire en racine carrée du temps. Un morceau de sucre met 110 h pour diffuser dans une tasse de 2 cm de café, si on n’agite pas.

Le désordre à l’échelle atomique et l’entropie statistique

A cause de la marche aléatoire, le désordre ne peut qu’augmenter. Cette loi naturelle est traduite dans la notion d’entropie et dans le deuxième principe de la thermodynamique. A l’échelle atomique, l’entropie a un sens tout à fait concret : elle représente le nombre de microétats équivalents accessibles à un système dans un état donné. Il s’agit de l’entropie statistique, que Boltzmann a définie et reliée à l’entropie thermodynamique au moyen de la constante de Boltzmann kB.

S = kB ln W

Où W est le nombre de microétats possibles.

Pour comprendre l’entropie statistique et envisager différents cas de désordre dans la matière et ses conséquences, nous prenons trois exemples.

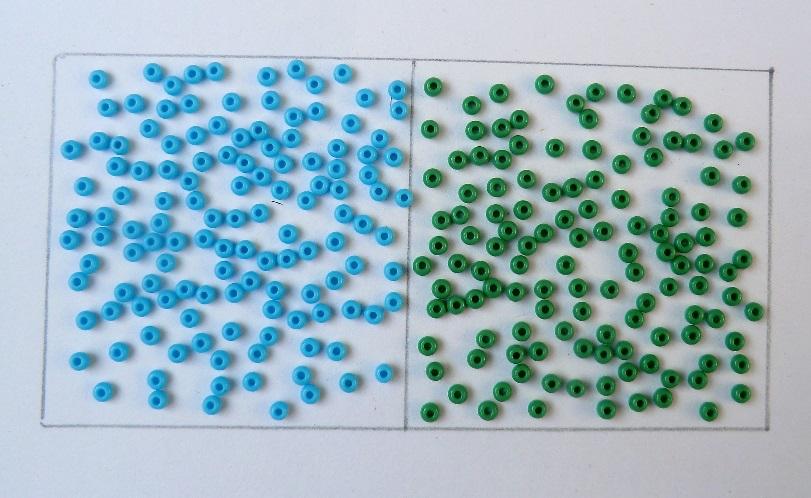

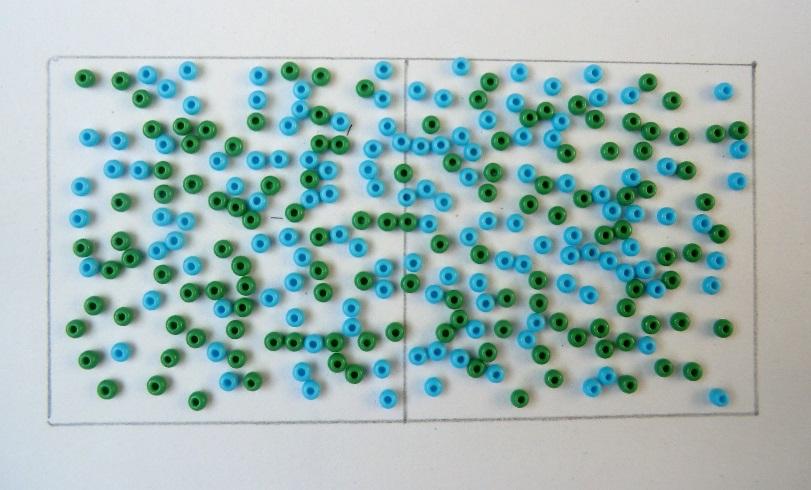

Le mélange chimique

Imaginons deux espèces A et B au départ séparées dans l’espace. A et B sont par exemple les molécules de deux gaz (O2 et N2) dans deux compartiments séparés par une cloison, ou les atomes d’un cristal d’argent et d’un cristal d’or. Lorsqu’on enlève la cloison, où lorsque qu’on place les deux cristaux en contact, du fait du déplacement chaotique des 2 espèces, celles-ci vont progressivement se mélanger jusqu’à l’état de mélange qui correspond au plus grand nombre de microétats possibles.

Exemple de N perles, la moitié est bleue, l’autre moitié est verte.

Etat totalement séparé : le nombre de micro-état est de 1. L’entropie est kB ln 1 = 0.

Etat totalement mélangé : le nombre de micro-états est de 2N. En effet chaque perle a 2 possibilités : soit bleue, soit verte. L’entropie est kB ln 2N = kB N ln 2 = 0,67 N.

Cet état est celui vers lequel tend naturellement le système des N perles, du fait du mouvement aléatoire. C’est l’état présentant le plus grand nombre de configurations possibles, donc la plus grande probabilité. On dit que c’est l’état « d’entropie maximale ». Remarquons qu’il s’agit d’un état parfaitement symétrique. Le désordre crée de la symétrie !

Les défauts dans la structure atomique

Considérons un cristal d’or. Sa structure atomique est très simple : il s’agit d’un empilement compact d’atomes d’or. Dans chaque plan compact, chaque atome d’or est entouré de 6 atomes d’or en contact.

[image perles]

Ce cristal est soumis à une agitation thermique caractérisée par sa température T. Cette agitation thermique, chaotique, crée des défauts dans sa structure tels que des lacunes (l’atome sort de son site et le laisse vide) ou des atomes en position interstitielle (l’atome sorti de son site va se mettre dans un interstice du réseau).

Tout cristal à l’équilibre possède une certaine quantité de défauts bien déterminée. Cette quantité est fixée par l’équilibre entre l’entropie, qui tend à être maximale, et l’enthalpie, c’est-à-dire l’énergie nécessaire pour créer ces défauts (à pression constante). Plus la température est élevée, plus le terme entropique l’emporte et la quantité de défauts augmente.

Les défauts jouent un rôle très important dans la plupart des propriétés du cristal. Par exemple la conductivité ionique est liée à l’existence de lacunes, qui donne aux ions la possibilité de migrer en sautant dans les lacunes.

La pelote de polymère

Considérons une chaîne de polymère constituée de 10000 maillons libres de s’orienter les uns par rapport aux autres. Du fait du caractère aléatoire de l’angle entre les maillons, l’extension de la chaîne de polymère est en moyenne de 10000=100 maillons. La chaîne n’est pas étendue dans l’espace sur une longueur de 10000 maillons, elle est repliée sur une longueur typique de 100 maillons. En effet, le nombre de configurations de la chaîne repliée avec une extension de 100 maillons est considérablement plus grand que le nombre de configuration de la chaîne étendue (qui est de 1) ! La chaîne a une probabilité beaucoup plus grande d’être repliée qu’allongée.

[photo d’une poignée d’élastiques]

Cette tendance entropique au repliement est à l’origine de l’élasticité des élastomères. Tirer sur un élastomère c’est vaincre les forces entropiques du repliement. Plus la température augmente, plus l’agitation thermique permet à la chaîne d’explorer ses différentes configurations ce qui favorise son repliement : l’élastomère devient plus dur quand on le chauffe.